L'EPFL ha sviluppato un programma che controlla una macchina tramite onde cerebrali per restituire autonomia alle persone che ne sono sprovviste.

Da molti anni due gruppi di ricercatori dell'EPFL stanno lavorando a soluzioni per restituire una certa autonomia ai tetraplegici.

L'idea è quella di utilizzare robot in grado di svolgere compiti al posto di quelle persone che non possono muoversi affatto.

Gli scienziati sono riusciti a sviluppare un programma per computer che controlla un robot utilizzando correnti elettriche emesse dal cervello. Non c'è bisogno di comandi vocali o digitali, basta un semplice pensiero.

Per il loro lavoro, i team di Aude Billard, professore e direttore del laboratorio di algoritmi e sistemi di apprendimento dell'EPFL, così come José del R. Millán, direttore del laboratorio di interfaccia cervello-macchina dell'EPFL, hanno utilizzato un braccio articolato sviluppato alcuni anni fa.

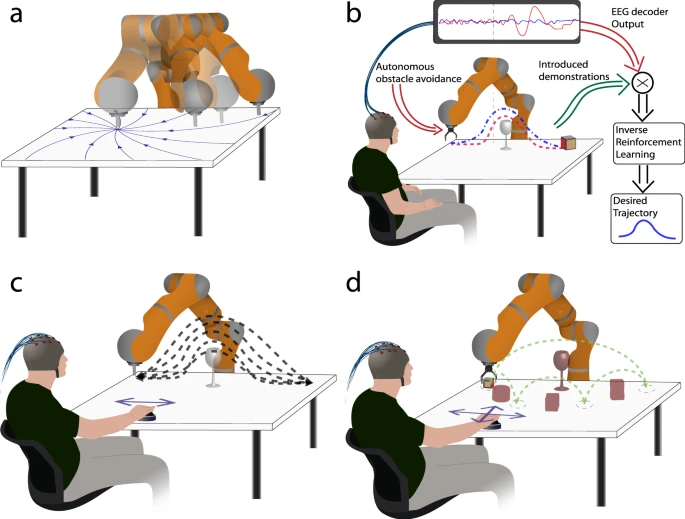

Può spostarsi da sinistra a destra e viceversa, spostare oggetti che si trovano nel suo campo visivo o evitarli.

'Il nostro robot è stato programmato per schivare un ostacolo, ma avremmo potuto anche decidere un'operazione completamente diversa come riempire un bicchiere d'acqua, spingere o tirare qualcosa, per esempio', spiega Aude Billard.

L'idea era quella di poter affinare la propria traiettoria, a volte troppo lontana dall'oggetto per essere evitata, a volte troppo vicina.

'Poiché lo scopo di questo robot è aiutare le persone paralizzate, avevamo bisogno di un modo per comunicare tra la persona e il robot che fosse non verbale e che non comportasse alcun movimento', ha affermato Carolina Gaspar Pinto Ramos Correia, studentessa di dottorato.

Gli scienziati hanno quindi sviluppato un algoritmo per modificare il comportamento del robot con il semplice pensiero. Un cappuccio dotato di elettrodi in grado di produrre un elettroencefalogramma (EEG) che registra i pensieri dell'utente.

L'utente non deve fare nulla. Deve solo guardare il robot. Se non è soddisfatto del suo comportamento, il suo cervello invia un segnale di errore evidente e identificabile, come dire: 'No, non mi va bene'.

Quest'ultimo poi si rende conto che ciò che sta realizzando è sbagliato, ma senza sapere esattamente cosa si rivela essere sbagliato. Passa troppo vicino all'ostacolo o al contrario troppo lontano?

Questo segnale di errore viene quindi utilizzato da un algoritmo di rinforzo inverso, in grado di identificare ciò che l'utente desiderava e come modificare il comportamento per soddisfare al meglio l'utente.

Per verificare che le sue detrazioni siano corrette, il robot eseguirà dei test. Per ottenere un comportamento che soddisfi l'utente, il robot è molto veloce.

Gli bastano dai tre ai cinque tentativi per capire e adattarsi il più possibile alla volontà del paralitico.

'Dotato di intelligenza artificiale, può imparare velocemente, ma deve scoprire quando ha commesso degli errori per correggerli. Rilevare il segnale di errore è stata una vera sfida tecnica', afferma José del R. Millán.

'La sfida era mettere in relazione l'attività cerebrale con il controllo del robot, in altre parole, tradurre i segnali dal cervello in azioni per il robot. Per fare ciò, utilizziamo l'apprendimento automatico per identificare l'attività cerebrale correlata a un'attività specifica. Quindi combiniamo queste informazioni con le azioni del robot per adattare il movimento del robot alle preferenze dell'utente',

afferma Iason Batzianoulis, autore principale della ricerca in 'Nature Communications Biology'.

A lungo termine, i ricercatori vogliono integrare questo algoritmo in una sedia a rotelle. “Oggi ci sono ancora sfide ingegneristiche irrisolte. Con una sedia a rotelle, la difficoltà è maggiore, poiché il corpo e il robot sono in movimento', spiega Aude Billard.

Gli scienziati vogliono anche combinare il loro algoritmo con un robot in grado di percepire diversi segnali, in modo da coordinare i dati ottenuti dal cervello con quelli delle capacità motorie visive.

Nessun commento:

Posta un commento